Sin dagli anni 90, la tecnologia digitale applicata alle tastiere musicali ha portato innovazione e ha ampliato gli orizzonti del fare musica al punto da sconvolgere i punti di riferimento tradizionali. Prima dell’avvento dell’elettronica e dell’informatica, si cominciava da ragazzi con l’imparare a suonare uno strumento. Quelli che non potevano permettersi la scelta del Conservatorio, si affidavano alle scuole di musica oppure a lezioni individuali con il maestro: partivano dal solfeggio e dai primi esercizi di apprendimento. Dimensioni e pesi erano tali da non pensare facilmente al trasporto: si acquistava un pianoforte verticale per la casa oppure un organo elettronico dalle dimensioni mastodontiche. Gli hotel, i teatri, le chiese, i luoghi dove si andava a suonare erano dotati di uno strumento residente e solitamente si suonava quello che si trovava in loco.

Ma insieme alla portabilità e alla potenza, la tecnologia digitale ha iniziato lentamente a ridefinire — e talvolta a snaturare — il ruolo stesso del musicista. L’evoluzione dei processori, dei campionamenti e degli algoritmi di generazione sonora ha portato a un paradosso: oggi spesso non ascoltiamo più chi suona, ma che cosa suona. Il rischio è che lo strumento prenda il sopravvento sul musicista, invertendo una gerarchia che per secoli è stata considerata intoccabile.

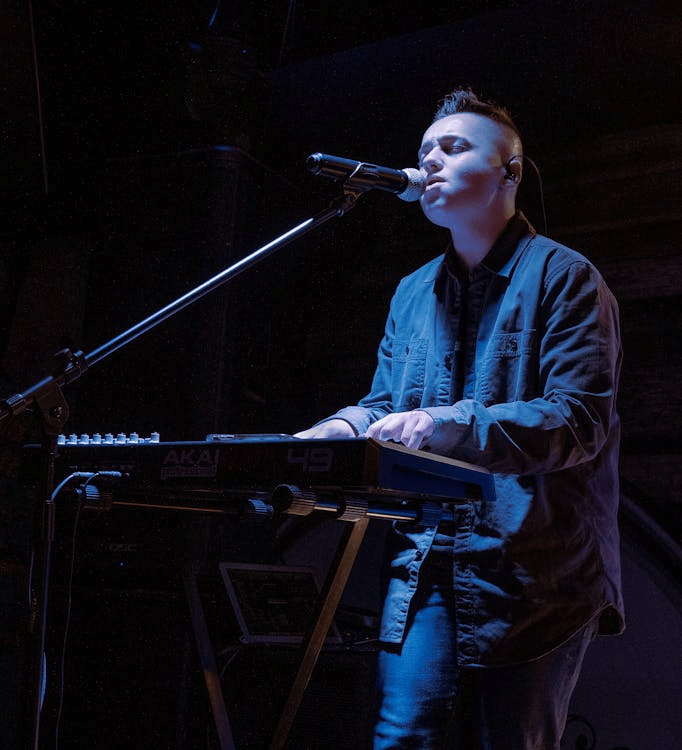

Da quando ci sono gli strumenti digitali – compatti e portatili – è tutto cambiato: come hanno fatto abitualmente i chitarristi, i violinisti e tutti gli altri musicisti, anche i tastieristi hanno potuto portare con sé il proprio strumento, montarlo sul palco in un amen e suonare.

Un tempo il suono era la conseguenza diretta del gesto, della tecnica, dell’intenzione. Il pianista era riconoscibile per il tocco, l’organista per la gestione del respiro e dei registri, il fisarmonicista per la sensibilità della mano sinistra. Oggi, invece, la qualità timbrica è sempre più determinata dalla macchina: dal campione multi-sorgente, dal DSP che modella la risonanza, dal motore di sintesi che “fa il carattere”. Il musicista rischia di diventare un operatore di preset, un selezionatore di possibilità, più che un interprete che plasma il suono.

E ora, con l’introduzione dell’intelligenza artificiale, questo processo accelera in modo esponenziale. L’AI non si limita a fornire nuovi strumenti: tende a sostituire parti del processo creativo, a generare arrangiamenti, accompagnamenti, perfino esecuzioni complete che imitano lo stile umano con una precisione inquietante. Il risultato è che l’essere umano rischia di scomparire dalla musica non solo come esecutore, ma anche come ideatore. L’ascoltatore, già abituato a identificare la bellezza del suono con la bontà dello strumento, ora rischia di non chiedersi più nemmeno se dietro quel brano ci sia una persona o un algoritmo.

La conseguenza è sottile ma profonda: la musica rischia di diventare un prodotto, non un gesto. Una sequenza di scelte statistiche, non un atto espressivo. E il musicista, se non reagisce, rischia di essere relegato al ruolo di supervisore di processi automatici, più che di creatore.

In questo scenario diventa importante tornare a mettere al centro chi suona. Non basta conoscere due funzioni dello strumento o affidarsi ai preset: serve capire davvero come reagisce, cosa può fare e cosa invece è meglio evitare. È un lavoro pratico, fatto di scelte concrete, non di teoria.

La tecnologia — anche quella più avanzata — può aiutare molto, ma solo se resta uno strumento nelle mani di chi suona. Quando inizia a decidere al posto nostro o a fare tutto da sola, il rischio è che la parte umana si perda per strada. Ritrovare un equilibrio significa ricordarsi che la musica nasce da una persona, non da un menu o da un algoritmo.